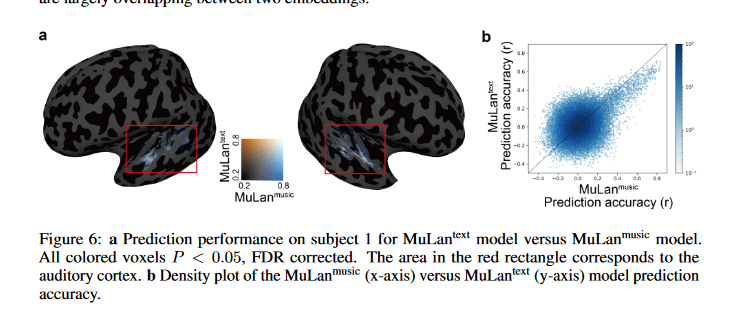

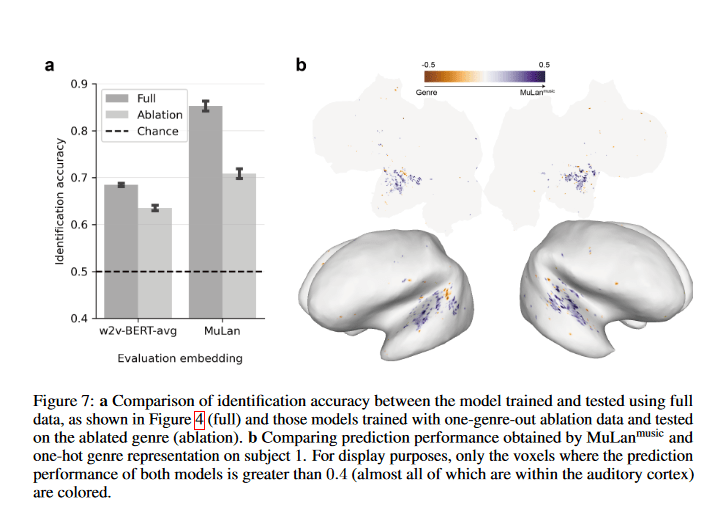

研究人员招募了 5 名志愿者,先让其听蓝调,古典,乡村,迪斯科,嘻哈,爵士乐,金属,流行,雷鬼和摇滚等不同音乐类型的 15 秒音乐片段,然后记录志愿者的 fMRI 数据。

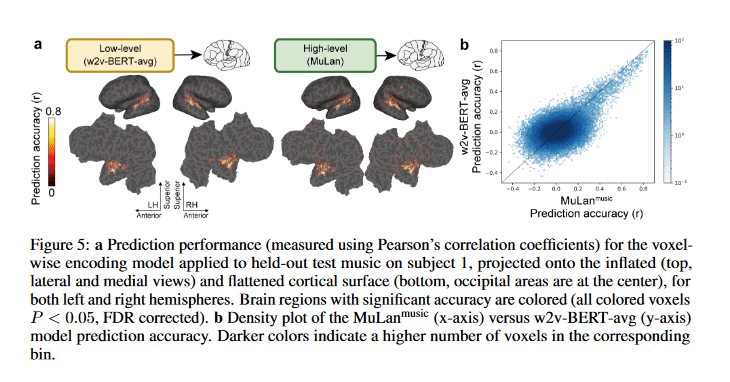

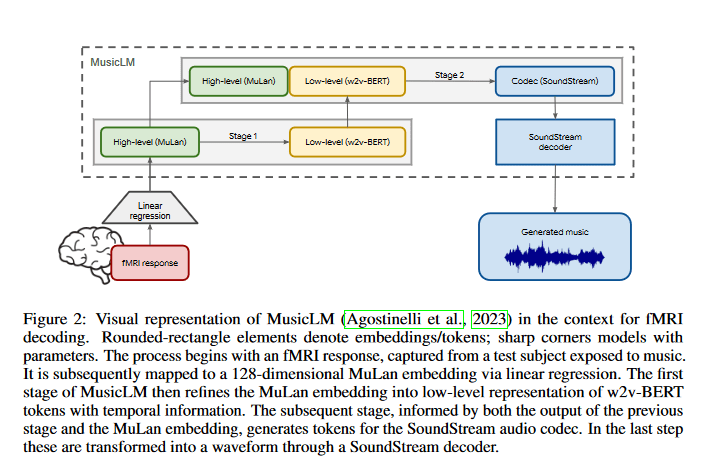

谷歌使用这些数据训练出一个深度神经网络,以了解大脑活动模式与音乐节奏和情感等不同元素之间的关系。

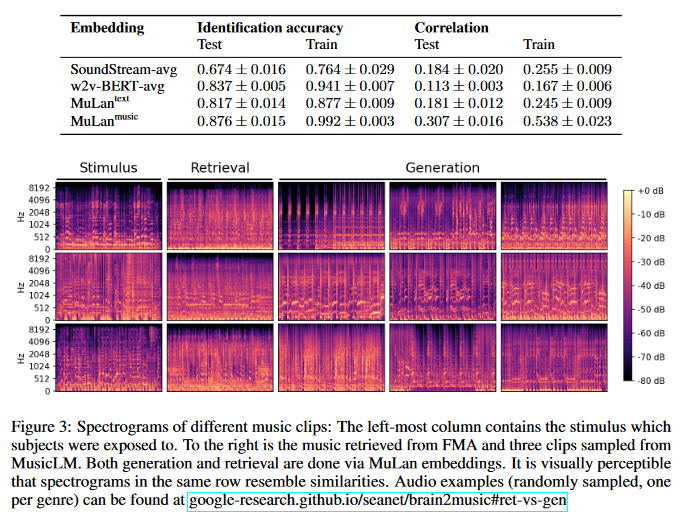

Brain2Music 基于谷歌此前推出的 MusicLM 模型(基于文本生成音乐片段),基于 fMRI 生成 15 秒音乐片段。

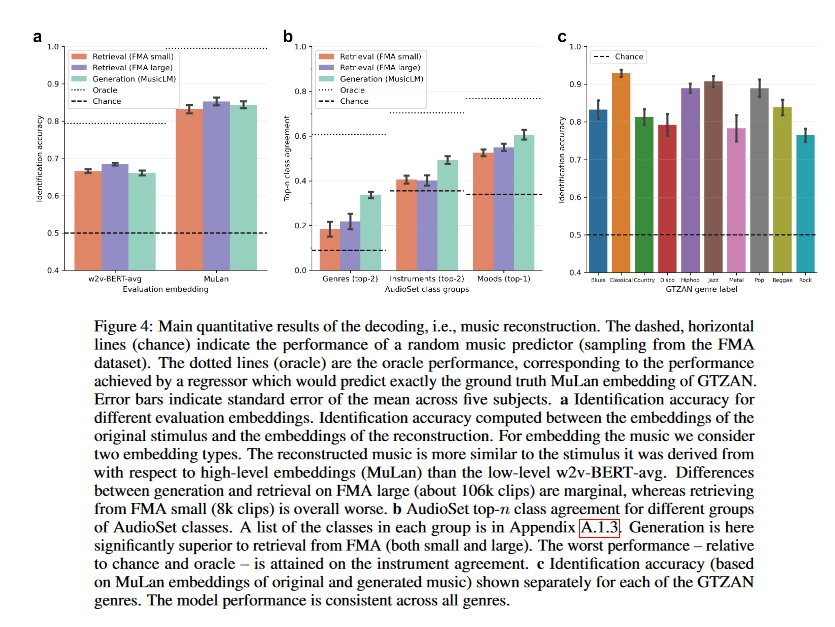

研究结果显示 Brain2Music 生成的 15 秒音乐片段,其中一段内容“Oops!...I Did It Again”和测试听到的原版音乐基本相同。